Meta lanza cuatro nuevos modelos de IA disponibles públicamente para uso de desarrolladores

Un equipo de investigadores en inteligencia artificial del equipo de Investigación Fundamental de IA de Meta ha puesto a disposición del público cuatro nuevos modelos de IA para que investigadores y desarrolladores puedan crear nuevas aplicaciones. El equipo ha publicado un artículo en el servidor de preimpresiones arXiv, en el que describe uno de los nuevos modelos, JASCO, y cómo podría ser utilizado.

A medida que crece el interés en las aplicaciones de IA, los principales actores del sector están creando modelos de IA que pueden ser utilizados por otras entidades para añadir capacidades de IA a sus propias aplicaciones. En este nuevo esfuerzo, el equipo de Meta ha puesto a disposición cuatro nuevos modelos: JASCO, AudioSeal y dos versiones de Chameleon.

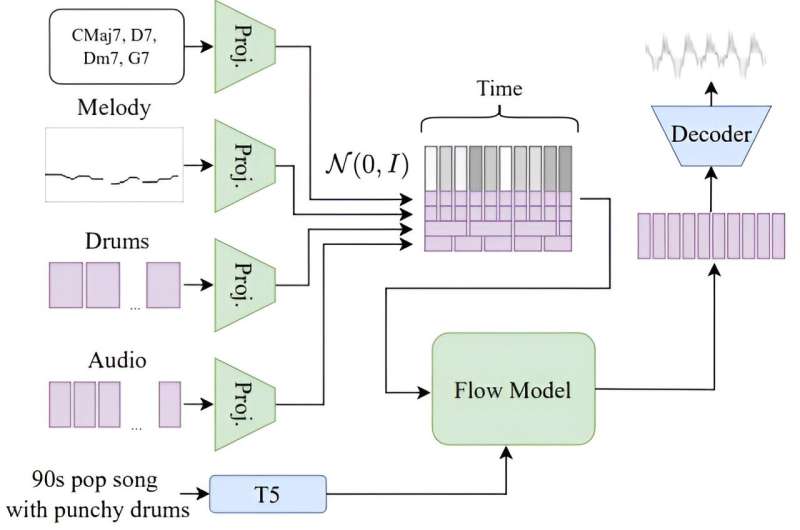

JASCO ha sido diseñado para aceptar diferentes tipos de entrada de audio y mejorar el sonido. Según el equipo, el modelo permite a los usuarios ajustar características como el sonido de los tambores, los acordes de guitarra o incluso las melodías para crear una pieza musical. El modelo también puede aceptar texto como entrada y lo utiliza para darle un matiz especial a la melodía.

Un ejemplo sería pedir al modelo que genere una melodía de blues con mucho bajo y tambores, seguido de descripciones similares para otros instrumentos. El equipo de Meta también comparó JASCO con otros sistemas diseñados para hacer lo mismo y descubrió que JASCO los superó en tres métricas principales.

AudioSeal puede utilizarse para añadir marcas de agua a los discursos generados por una aplicación de IA, permitiendo que los resultados se identifiquen fácilmente como generados artificialmente. Además, señalan que también puede utilizarse para marcar con agua segmentos de discursos de IA que se hayan añadido a discursos reales, y que se ofrecerá con una licencia comercial.

Los dos modelos de Chameleon convierten texto en representaciones visuales y se lanzan con capacidades limitadas. Según el equipo, ambas versiones, 7B y 34B, requieren que los modelos desarrollen una comprensión tanto del texto como de las imágenes. Debido a esto, pueden realizar un procesamiento inverso, como generar subtítulos para imágenes.